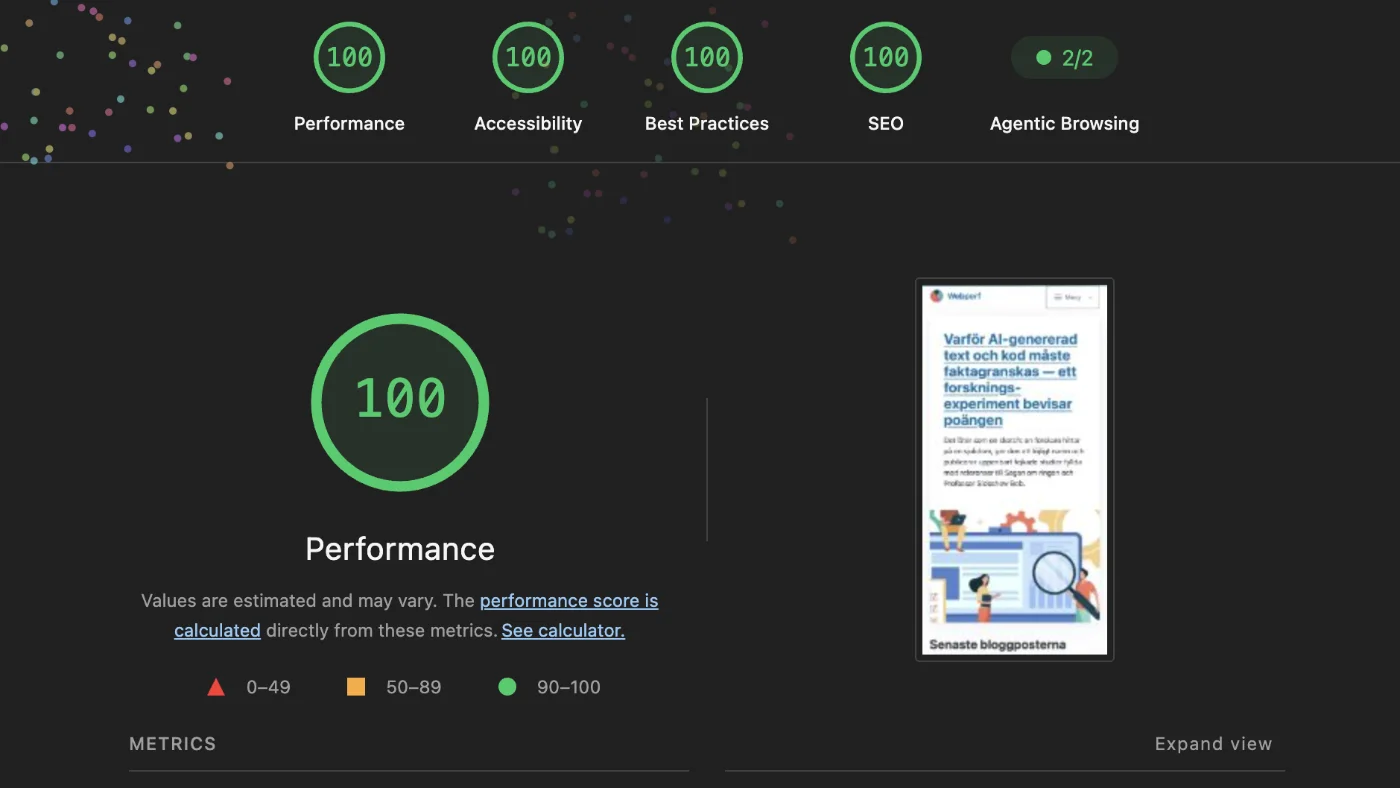

Agentic Browsing

är märkt som under utveckling, och det är ett ärligt erkännande av att det fortfarande råder osäkerhet om vad som faktiskt behövs för att utvärdera agenters besök på webbplatser. Ändå är den värd att titta närmare på. Det handlar inte om ett brådskande krav utan snarare om ett fönster mot en pågående förändring i hur webben används.

Vad är egentligen den agentiska webben?

Begreppet syftar på det växande ekosystemet av AI-agenter som kan utföra uppgifter på webben på uppdrag av en användare. I stället för att en människa navigerar manuellt kan ett AI-system planera, klicka, fylla i formulär och hämta information relativt självständigt.

Det är värt att hålla koll på proportionerna. Agentbaserad trafik utgör i dag en liten andel av den totala webbtrafiken. De flesta besökare är fortfarande människor som använder en webbläsare på vanligt sätt. Men AI-agenter finns redan där ute, och användningen ökar rimligtvis i takt med att verktygen blir tillgängligare och mer pålitliga. Cloudflare uppskattade under 2025 att automatiserad och AI-driven trafik stod för en växande men fortfarande begränsad del av det totala flödet.

Agenter läser webbplatser på ett annorlunda sätt än vi gör. De arbetar primärt med tre representationer av en sida: skärmbilder som tolkas av en bildanalyserade modell, rå HTML-kod där elementhierarkin ger strukturinformation, och tillgänglighetsträdet

. Tillgänglighetsträdet är en förenklad, semantisk version av sidan som webbläsaren bygger upp och som redan används av skärmläsare. För en agent fungerar det som en ren karta över sidans interaktiva element, utan visuellt brus.

Vad kontrollerar den nya kategorin?

Lighthouse kombinerar befintliga mätvärden med två nya kontroller specifikt utformade för det agentiska sammanhanget.

Tillgänglighetsträdet är välformat

Det här är egentligen ingen ny kontroll utan en sammanställning av befintliga tillgänglighetskontroller. Om interaktiva element saknar meningsfulla etiketter, namn eller roller kan varken en skärmläsare eller en agent förstå vad de ska göra. Grundarbetet är detsamma oavsett vilket syfte vi lyfter fram.

→ The Accessibility Tree (web.dev)

Layoutskiften via CLS

Layoutskiften mäts via det välbekanta CLS-måttet (Cumulative Layout Shift). En agent som tar skärmbilder i snabb följd kan bli förvirrad av innehåll som rör sig under inläsningen. Agenter arbetar ofta snabbare än en mänsklig besökare och kan inte anpassa sig på samma vis.

→ Cumulative Layout Shift (CLS) (web.dev)

WebMCP

WebMCP är ett relativt nytt API som låter webbplatser exponera specifika kommandon via annoterade HTML-formulär eller kod, kommandon som agenter kan använda direkt. Lighthouse kontrollerar om annotationerna finns och om de följer det förväntade schemat. Det är en frivillig implementering och ingen förväntas ha det på plats redan i dag.

→ Registered WebMCP tools (Chrome for Developers)

llms.txt

Det är en konvention, liknande robots.txt, där webbplatser kan ge AI-agenter och crawlers övergripande information om webbplatsen. Lighthouse kontrollerar om filen följer rekommendationerna för format och innehåll. Det är en standard under framväxt och det råder delade meningar om hur stor praktisk effekt den har för tillfället, men att lägga in den är inte betungande.

→ llms.txt (Chrome for Developers)

Det är värt att nämna att en helt vanlig webbplats kan få godkänt i kategorin utan några av dessa implementeringar. Verktyget testar att grundkvaliteten är på plats, inte att sajten är utrustad för agentinteraktion.

Varför är det ändå intressant att följa?

Det finns en tydlig signal i att Google väljer att lägga in den här kategorin i Lighthouse nu, om än märkt som under utveckling. Det tyder på att frågan om hur webbplatser fungerar för icke-mänskliga besökare kommer att bli en alltmer relevant del av webbkvalitetsbedömningen framöver åtminstone i Lighthouse. Och praktiskt för de som gjort dessa agent-implementationer att kontinuerligt kunna testa att det håller måttet.

Det som är uppmuntrande är att grundarbetet i stor utsträckning redan är känt för oss som jobbar med att bemästra dessa typer av tester. Semantisk HTML, väl uppmärkta formulär, stabila layouter och tillgängliga element gynnar alla besökare, mänskliga som agentiska. Det är ett område där god praxis och framtida kompatibilitet pekar i samma riktning.

Vi kan testa den nya kategorin redan nu via kommandoradsverktyget för Lighthouse. PageSpeed Insights och Chrome DevTools förväntas ta med Lighthouse 13.3 inom de närmaste månaderna.

Vill du testa din webbplats redan idag?

Först behöver du installera den senaste Lighthouse. Via terminalen med NPM kör du sudo npm install -g lighthouse@latest efter det skriver du detta: lighthouse https://minwebbplats.se och väntar en stund. Resultatet kommer skrivas ut i terminalen men du får också en HTML-rapport som fil skriven i den katalog du står i.

Läs mer om den agentiska webben

- Google Lighthouse Has A New Agentic Browsing Category (DebugBear)

- Build agent-friendly websites (web.dev)

- Accessibility for agents (Chrome for Developers)

- What's new in DevTools Chrome 148 (Chrome for Developers)

- Lighthouse releases (Github)